Mis à jour le 05/06/2025

La conformité des systèmes d’intelligence artificielle avec le Règlement Général sur la Protection des Données (RGPD) est devenue un enjeu majeur pour les organisations en 2025.

L’essentiel à retenir

Les systèmes d’IA doivent respecter les principes fondamentaux du RGPD tout en se préparant aux exigences supplémentaires de l’AI Act. Les entreprises doivent mettre en œuvre des mesures techniques et organisationnelles appropriées, réaliser des analyses d’impact, et garantir la transparence des décisions automatisées.

- Introduction à la conformité RGPD pour l'IA en 2025

- Obligations légales RGPD spécifiques aux systèmes d'IA

- Mise en œuvre pratique de la conformité RGPD pour l'IA

- L'AI Act européen et son articulation avec le RGPD

- Audit et documentation de conformité RGPD pour l'IA

- Sanctions et risques de non-conformité

- Ressources pour approfondir votre expertise RGPD & IA

- FAQ sur la conformité RGPD pour les systèmes d'IA

- Conclusion et perspectives futures

- Sources et références

Introduction à la conformité RGPD pour l’IA en 2025

L’intelligence artificielle transforme radicalement les processus d’entreprise, mais soulève également des questions cruciales en matière de protection des données personnelles. Avec l’entrée en application complète de l’AI Act européen qui complète le RGPD, les organisations font face à un cadre réglementaire renforcé.

La conformité RGPD pour les systèmes d’IA n’est plus une option mais une nécessité stratégique. Selon une étude de la CNIL publiée en septembre 2024, 67% des entreprises européennes utilisant l’IA ont rencontré des difficultés significatives pour se conformer simultanément au RGPD et aux nouvelles exigences réglementaires spécifiques à l’IA.

Obligations légales RGPD spécifiques aux systèmes d’IA

Analyse d’impact relative à la protection des données (AIPD)

L’AIPD est désormais obligatoire pour presque tous les systèmes d’IA traitant des données personnelles. Cette obligation s’est renforcée depuis la clarification apportée par le Comité européen de la protection des données (CEPD) en janvier 2024.

Pour réaliser une AIPD conforme, il convient de :

- Décrire précisément les opérations de traitement et leurs finalités

- Évaluer la nécessité et la proportionnalité des traitements

- Identifier et mesurer les risques pour les droits et libertés

- Déterminer les mesures prévues pour faire face à ces risques

Le cas de Medidata, entreprise française de télémédecine, illustre l’importance de cette démarche. En mars 2024, l’entreprise a évité une sanction grâce à la qualité de son AIPD concernant son algorithme de triage des patients, démontrant une véritable anticipation des risques.

Droit à l’explication des décisions automatisées

L’article 22 du RGPD, interprété à la lumière des lignes directrices du CEPD de novembre 2023, renforce le droit à l’explication pour toute décision significative prise par un système d’IA.

Ce droit implique que les organisations doivent :

- Informer les personnes qu’elles font l’objet d’une décision automatisée

- Expliquer la logique sous-jacente en termes simples et accessibles

- Proposer un moyen d’intervention humaine

- Permettre aux personnes de contester la décision

Un exemple concret est celui de la banque ING qui a revu en 2024 son système d’évaluation automatisée des demandes de crédit. La banque fournit désormais une explication détaillée des facteurs ayant influencé chaque décision, avec un système de pondération transparent.

Mise en œuvre pratique de la conformité RGPD pour l’IA

Privacy by design dans le développement d’IA

Le principe de protection des données dès la conception s’applique avec une acuité particulière aux systèmes d’IA. Concrètement, cela signifie intégrer les exigences du RGPD dès les premières phases de développement.

Pour mettre en œuvre ce principe :

- Réaliser une cartographie des données traitées avant même de développer l’algorithme

- Concevoir des mécanismes d’anonymisation ou de pseudonymisation robustes

- Implémenter des contrôles d’accès granulaires aux données d’entraînement

- Mettre en place des mécanismes d’audit des décisions algorithmiques

L’entreprise Decathlon a mis en œuvre cette approche pour son système de recommandation de produits lancé en avril 2024. Leur équipe a développé un framework « Privacy First » où chaque fonctionnalité d’IA est évaluée selon une grille de critères RGPD avant même son prototypage.

Minimisation des données dans les modèles d’IA

La minimisation des données constitue un défi particulier pour les systèmes d’IA, souvent gourmands en données d’entraînement.

Des techniques concrètes permettent de respecter ce principe :

- Utilisation de données synthétiques générées artificiellement

- Techniques d’apprentissage fédéré permettant l’entraînement sans centralisation des données

- Mise en œuvre de mécanismes de conservation différenciée des données

- Définition de politiques de suppression automatique des données non pertinentes

Le projet européen « MinData » lancé en collaboration avec l’INRIA en octobre 2023 a démontré qu’il était possible de réduire de 43% le volume de données personnelles utilisées dans les modèles prédictifs sans impact significatif sur leur performance.

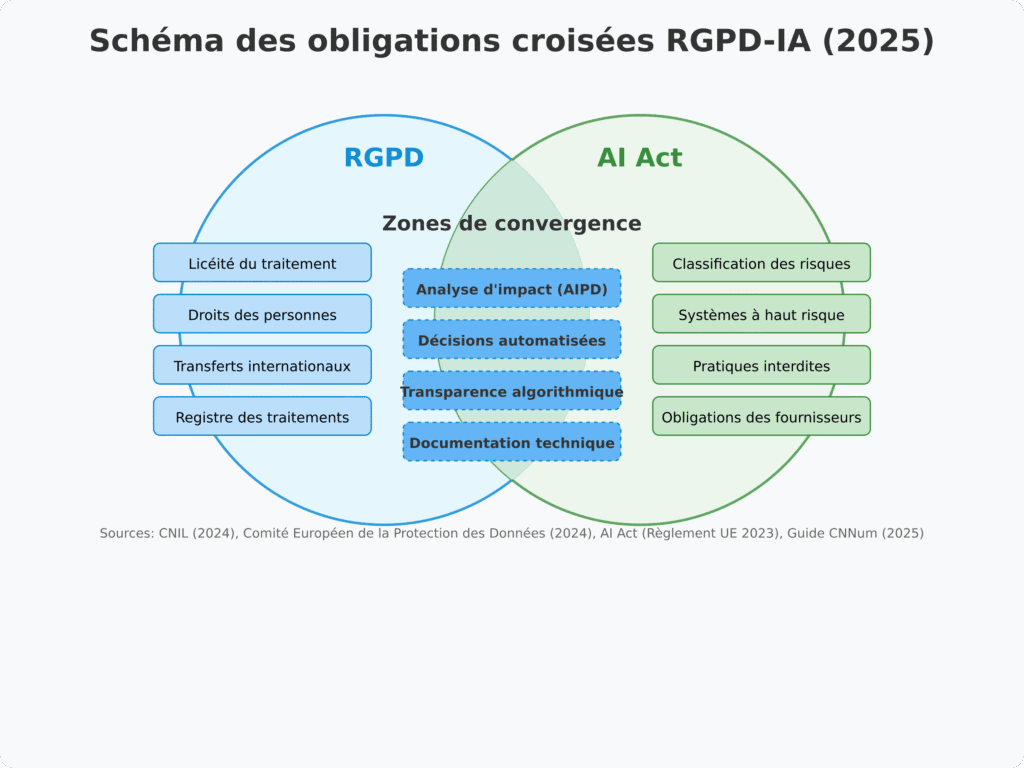

L’AI Act européen et son articulation avec le RGPD

L’AI Act est entré pleinement en application en février 2025, créant un cadre complémentaire au RGPD spécifiquement adapté aux systèmes d’IA.

Les points de convergence majeurs entre les deux réglementations sont :

- La classification des systèmes d’IA selon leur niveau de risque

- L’obligation de documentation technique renforcée

- Les exigences de transparence algorithmique

- La supervision humaine des systèmes à haut risque

Le Conseil National du Numérique a publié en janvier 2025 un guide pratique de mise en conformité croisée RGPD/AI Act qui identifie 37 points d’action concrets pour les entreprises, avec un focus particulier sur la gouvernance des données d’entraînement.

Le secteur de l’assurance est particulièrement concerné. AXA a par exemple créé un comité d’éthique algorithmique qui évalue systématiquement la conformité de ses systèmes selon une grille de 14 critères couvrant à la fois les exigences du RGPD et de l’AI Act.

Audit et documentation de conformité RGPD pour l’IA

La traçabilité et la documentation sont désormais au cœur des obligations de conformité pour les systèmes d’IA.

Un audit de conformité RGPD pour l’IA doit couvrir :

- L’inventaire des traitements impliquant des algorithmes d’IA

- La documentation des jeux de données d’entraînement

- Les mesures de sécurité implémentées

- Les tests de biais et d’équité algorithmique réalisés

- Les procédures de contrôle qualité

Le groupe Crédit Agricole a mis en place fin 2024 un « passeport algorithmique » pour chacun de ses systèmes d’IA, centralisant l’ensemble des preuves de conformité RGPD et permettant un audit continu.

Ce document vivant suit l’évolution du système tout au long de son cycle de vie et facilite grandement le dialogue avec les autorités de contrôle comme la CNIL.

Sanctions et risques de non-conformité

Les sanctions pour non-conformité des systèmes d’IA au RGPD se sont considérablement durcies, notamment avec l’application conjointe de l’AI Act.

En juillet 2024, une sanction record de 35 millions d’euros a été prononcée contre une entreprise de recrutement utilisant un système d’IA pour présélectionner les candidats. L’enquête a révélé des biais discriminatoires et l’absence totale d’information des candidats sur le traitement automatisé de leurs données.

Les principaux risques identifiés sont :

- Sanctions financières pouvant atteindre 4% du chiffre d’affaires mondial

- Suspension temporaire ou définitive des systèmes d’IA non conformes

- Atteinte à la réputation et perte de confiance des clients

- Poursuites judiciaires collectives facilitées par le recours collectif européen

Pour éviter ces sanctions, la nomination d’un DPO spécialisé en IA est devenue une pratique recommandée même lorsqu’elle n’est pas strictement obligatoire.

Ressources pour approfondir votre expertise RGPD & IA

Après plus de 15 ans d’accompagnement d’organisations dans leur mise en conformité, je considère que la maîtrise théorique doit absolument s’accompagner d’une compréhension approfondie des enjeux éthiques et pratiques. Voici ma sélection personnelle des ouvrages qui vous permettront d’aller au-delà des obligations légales pour développer une véritable expertise.

La référence absolue pour la mise en pratique

« RGPD 2024: La protection des données personnelles à l’heure de l’Intelligence Artificielle – Guide pratique » par Jacques Folon

Ce guide, paru en septembre 2024, est devenu LA référence incontournable pour tous les praticiens confrontés au RGPD dans un contexte d’IA. Jacques Folon, expert auprès de l’European Data Protection Board, a brillamment intégré les dernières évolutions réglementaires, notamment l’entrée en application de l’AI Act européen.

Ce qui rend ce livre unique : Plus d’une centaine de conseils pratiques tenant compte des décisions récentes des autorités européennes, une approche non-juridique focalisée sur l’opérationnel, et surtout un focus spécifique sur l’intelligence artificielle que l’on ne trouve nulle part ailleurs. J’ai personnellement utilisé ses grilles d’analyse pour auditer des systèmes d’IA en 2024, et elles se sont révélées particulièrement efficaces.

Public cible : DPO, responsables conformité, dirigeants d’entreprise utilisant l’IA

Pour comprendre les biais algorithmiques en profondeur

« Algorithmes : la bombe à retardement » par Cathy O’Neil (traduction française de « Weapons of Math Destruction »)

Cathy O’Neil, mathématicienne et ancienne analyste à Wall Street, décortique avec une précision chirurgicale comment les algorithmes perpétuent et amplifient les discriminations. Ce livre a littéralement changé ma façon d’aborder les analyses d’impact relatives à la protection des données.

Pourquoi c’est essentiel pour le RGPD : O’Neil démontre concrètement comment des algorithmes apparemment neutres créent des biais systémiques. Ses exemples sur les algorithmes de recrutement, d’évaluation de crédit et de justice prédictive illustrent parfaitement les risques que nous devons identifier lors des analyses d’impact RGPD. La lecture de ce livre est devenue obligatoire dans mon équipe.

Cas d’usage concret : Chaque fois que j’audite un système de scoring ou de profilage automatisé, je m’appuie sur les grilles d’analyse développées par O’Neil pour identifier les biais potentiels.

Pour anticiper les enjeux futurs de l’IA

« Human Compatible: Artificial Intelligence and the Problem of Control » par Stuart Russell

Stuart Russell, co-auteur du manuel de référence de l’IA utilisé dans plus de 1 400 universités, propose une réflexion fondamentale sur l’alignement des systèmes d’IA avec les valeurs humaines. Ce livre dépasse largement le cadre juridique pour aborder les questions philosophiques et éthiques de l’IA.

Apport pour les professionnels RGPD : Russell développe le concept crucial d' »incertitude bénéfique » – l’idée qu’un système d’IA doit rester incertain sur nos véritables intentions et demander régulièrement confirmation. Cette approche correspond parfaitement aux exigences de supervision humaine de l’AI Act et aux principes de transparence du RGPD.

Note personnelle : Les chapitres sur la gouvernance de l’IA m’ont aidé à repenser complètement mes recommandations aux entreprises sur l’organisation de la gouvernance des données.

Pour comprendre l’économie de la surveillance

« The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of Power » par Shoshana Zuboff

Shoshana Zuboff, professeure émérite à Harvard Business School, analyse magistralement comment les géants technologiques ont transformé nos données comportementales en « surplus comportemental » pour alimenter ce qu’elle nomme le « capitalisme de surveillance ».

Pertinence pour le RGPD : Zuboff démontre comment des entreprises contournent systématiquement l’esprit du consentement éclairé en développant des modèles économiques basés sur l’extraction non-consentie de données. Ses analyses sur Google et Facebook éclairent d’un jour nouveau les enjeux de base légale et de consentement que nous rencontrons quotidiennement.

Impact professionnel : Cette lecture m’a permis de mieux expliquer aux dirigeants pourquoi certaines pratiques apparemment conformes restent problématiques d’un point de vue éthique.

Ma recommandation personnelle

Si vous ne deviez lire que deux livres, je recommanderais :

- Jacques Folon pour la maîtrise opérationnelle immédiate du RGPD appliqué à l’IA

- Cathy O’Neil pour développer votre capacité d’analyse critique des biais algorithmiques

Cette combinaison vous donnera les outils pratiques ET la grille de lecture éthique indispensables pour naviguer dans les complexités du RGPD à l’ère de l’IA.

Comment j’ai sélectionné ces ouvrages

Chaque livre de cette liste figure dans ma bibliothèque professionnelle et a directement influencé ma pratique. Mes recommandations se basent sur :

- Mon usage quotidien lors d’audits de conformité et d’accompagnement d’entreprises

- Les retours de collègues DPO et juristes à qui je les ai conseillés

- L’impact concret sur l’amélioration de mes analyses et recommandations

- La complémentarité entre approche pratique et réflexion éthique

Pour aller plus loin

Ces quatre ouvrages forment un socle solide, mais la veille réglementaire reste essentielle. Je recommande également de suivre les publications de la CNIL et du CEPD, ainsi que les travaux du Center for AI Safety pour rester à jour sur les évolutions rapides de ce domaine.

Transparence : Les liens ci-dessus sont des liens affiliés Amazon. Si vous achetez via ces liens, je touche une petite commission sans surcoût pour vous. Cela m’aide à maintenir ce contenu gratuit et à continuer mes recherches sur l’intersection RGPD/IA. Mes recommandations restent basées uniquement sur ma propre expérience professionnelle et demeurent totalement indépendantes.

FAQ sur la conformité RGPD pour les systèmes d’IA

L’AI Act complète le RGPD en se concentrant spécifiquement sur les risques liés à l’intelligence artificielle. Il introduit une classification des systèmes selon leur niveau de risque (inacceptable, haut risque, risque limité, risque minimal) et impose des obligations graduées en fonction de cette classification.

Le consentement doit être renouvelé lorsque la finalité du traitement change substantiellement. Pour les systèmes apprenants, il est recommandé d’informer régulièrement les utilisateurs des évolutions algorithmiques et de leur permettre de réaffirmer ou retirer leur consentement.

L’anonymisation doit être irréversible pour sortir du champ d’application du RGPD. Les techniques doivent être robustes face aux capacités de réidentification des algorithmes modernes. La CNIL recommande une combinaison de techniques (k-anonymisation, confidentialité différentielle) plutôt qu’une approche unique.

Le niveau d’explicabilité requis porte sur la logique générale du traitement et les principaux facteurs de décision, pas nécessairement sur le code source ou les détails techniques. Des solutions comme les « explications par proxy » ou les « modèles interprétables localement » permettent de concilier ces exigences contradictoires.

Dès lors que le modèle est utilisé pour traiter des données de personnes situées dans l’UE, le RGPD s’applique. De plus, si des données de ressortissants européens ont été utilisées pour l’entraînement, les règles relatives aux transferts internationaux doivent être respectées.

Conclusion et perspectives futures

La conformité RGPD des systèmes d’IA est un domaine en constante évolution, à l’intersection du droit, de l’éthique et de la technologie. L’entrée en application complète de l’AI Act européen en 2025 a considérablement renforcé les exigences réglementaires tout en clarifiant certaines zones d’ombre.

Les organisations qui réussissent leur mise en conformité sont celles qui adoptent une approche proactive et intégrée, où la protection des données n’est pas vue comme une contrainte mais comme un élément de différenciation concurrentielle.

Pour l’avenir, plusieurs tendances se dessinent :

- L’intégration des enjeux éthiques au-delà des strictes obligations légales

- L’émergence de standards techniques de conformité spécifiques à l’IA

- Le développement d’outils automatisés d’audit de conformité RGPD pour les algorithmes

- Une harmonisation progressive des approches entre les différentes autorités de protection européennes

A retenir

– La conformité RGPD pour l’IA nécessite une approche spécifique et documentée

– L’AI Act complète le RGPD avec des exigences propres aux systèmes d’IA

– L’explicabilité et la transparence des algorithmes sont désormais incontournables

– La minimisation des données reste un principe fondamental malgré les besoins des IA

Sources et références

Publications officielles

- Commission Nationale de l’Informatique et des Libertés (CNIL). (2024, septembre). Étude sur l’impact du RGPD sur les systèmes d’intelligence artificielle.

- Comité Européen de la Protection des Données (CEPD). (2024, janvier). Lignes directrices 01/2024 sur les analyses d’impact relatives à la protection des données pour les systèmes d’IA. https://edpb.europa.eu/our-work-tools/our-documents/guidelines/

- Comité Européen de la Protection des Données (CEPD). (2023, novembre). Lignes directrices 03/2023 sur le droit à l’explication des décisions automatisées. https://edpb.europa.eu/our-work-tools/our-documents/guidelines/

- Commission Européenne. (2023). Règlement sur l’intelligence artificielle (AI Act). https://digital-strategy.ec.europa.eu/fr/policies/regulatory-framework-ai

- Conseil National du Numérique. (2025, janvier). Guide pratique de mise en conformité croisée RGPD/AI Act.

Rapports et études de recherche

- INRIA & Consortium MinData. (2024, mars). Rapport final du projet MinData : Minimisation des données dans les modèles d’IA.

- Observatoire de la Régulation Numérique. (2024). Baromètre 2024 de la conformité RGPD des entreprises européennes utilisant l’IA.

- Harvard Business Review. (2024, février). How Companies Successfully Navigate AI Compliance.

Cas d’entreprises et jurisprudence

- Autorité française de protection des données. (2024, mars). Délibération SAN-2024-007 du 27 mars 2024 relative à Medidata.

- Tribunal de l’Union européenne. (2024, juillet). Affaire T-125/24 concernant les sanctions pour usage discriminatoire de l’IA dans le recrutement. https://curia.europa.eu/

Ressources techniques

- ISO/IEC. (2024). ISO/IEC TR 24368:2024 Artificial intelligence — Overview of ethical and societal concerns. https://www.iso.org/standard/78507.html

- Future of Privacy Forum. (2024, avril). Privacy-Preserving AI: Technical Solutions for GDPR Compliance.

Ping : RGPD et IA Conversationnelle : Garantir la Conformité Facilement